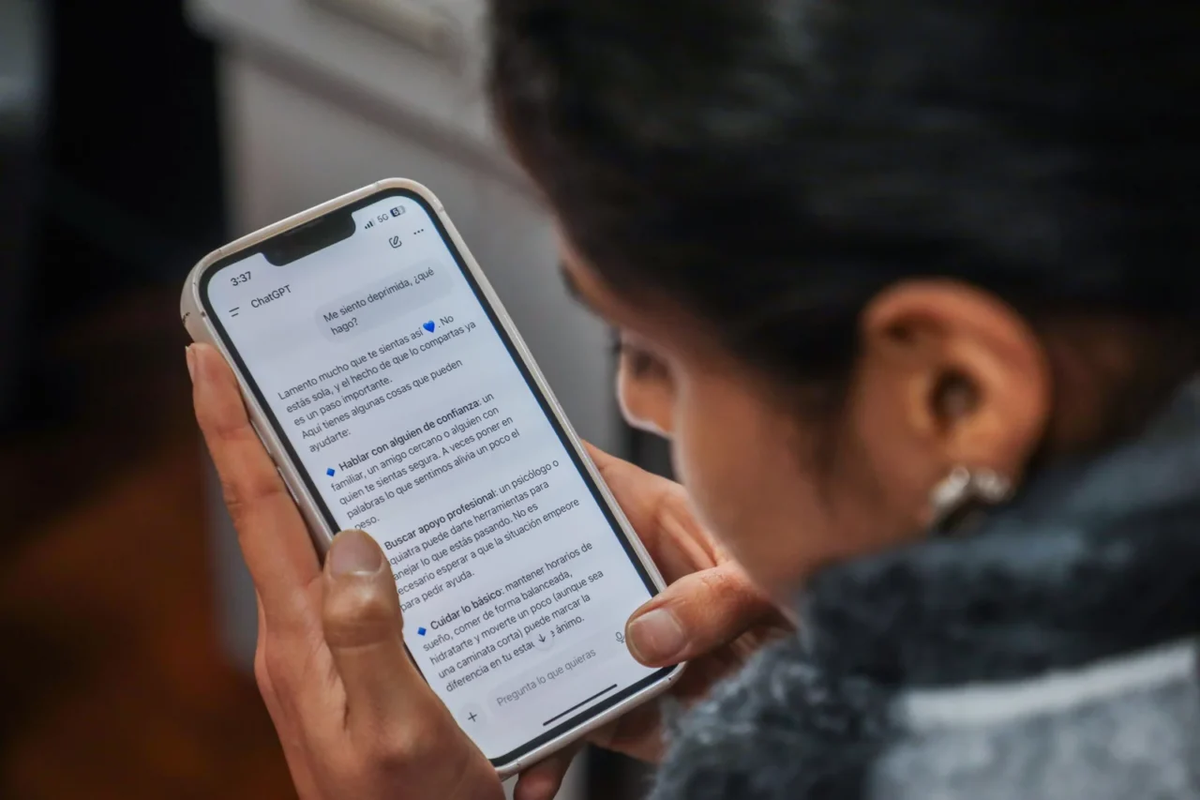

Cada vez más personas usan la inteligencia artificial como psicólogo: ¿aporta a la salud mental?

El uso de ChatGPT para consultas de salud mental se expande. Especialistas advierten sobre los límites de la inteligencia artificial en procesos terapéuticos.

Cada vez más personas usan la inteligencia artificial como psicólogo: ¿aporta a la salud mental?

“Le pregunté al ChatGPT ”, ya no es una rareza ni un gesto curioso: es una escena cotidiana. La frase aparece en conversaciones entre amigos, en grupos de WhatsApp y también en momentos de angustia. No se trata sólo de recetas de cocina o instrucciones prácticas —cómo cambiar una lamparita— sino de algo más: cada vez más personas recurren a un bot para hablar de lo que les pasa.

Te podría interesar

El mismo bot te lleva a confiarle tus problemas, ya que su diseño apunta a aumentar la interacción y eso implica una voz amable que ofrece cada vez más.

Marc Zao-Sanders desarrolló estudios de la Harvard Business Review que situaron, en 2025, en primer lugar el uso de la Inteligencia Artificial para terapia o acompañamiento. En 2024, ese uso ocupaba el segundo lugar.

¿Pueden las inteligencias artificiales reemplazar la interacción que genera una terapia? No hay una sola respuesta. El empresario Santiago Bilinkis afirma: “La clave en una terapia es la transferencia; si ese vínculo se da con un bot, ¿por qué no?”.

Lo dijo en un programa de radio, tras relatar un estudio en el que un jurado especializado consideraba mejores las respuestas de la IA frente a las de psicólogos humanos.

Uno de los estudios fue publicado en JAMA Medicina Interna. “En este estudio transversal de 195 preguntas de pacientes seleccionadas al azar de un foro de redes sociales”, dice el artículo firmado por John W. Ayers, Adam Poliak, Mark Dredze y otros.

“Las respuestas del chatbot fueron preferidas a las de los médicos y obtuvieron una calificación significativamente superior tanto en calidad como en empatía”, dice el informe.

La ilusión de la respuesta

Esa mirada, centrada en la eficacia de la respuesta y en la posibilidad de construir un vínculo, contrasta con la posición del psicoanalista Alejandro Benedetto, también docente y escritor. Para él, la respuesta es categórica: nunca puede reemplazar al psicoanálisis, que “no trabaja con la inteligencia”.

Benedetto cita a Norbert Elias, quien escribió El proceso de la civilización. “La gente fue delegando procesos corporales en la tecnología, en la cotidianidad misma; de ahí vienen problemas como el sedentarismo”.

Para el psicoanalista, el uso del chat como “analista” es “un paso más”. “Acá hay delegación de funciones intelectuales. Delegaste, te fue bien, hizo de secretaria, te resumió un texto, escribió algo que le pediste y dejás de hacer ese trabajo intelectual que es esforzado, pero también placentero”, dice Benedetto.

“Cuando te querés dar cuenta, delegaste lo físico y lo intelectual”, sigue su desarrollo.

Desde una perspectiva psicoanalítica, “se ha encontrado un nuevo dios. Un dios que te responde, porque podés hablar con una fuente maestra”. Lo que no ubica la máquina es “el enigma de cada uno”.

Quien consulta a un psicólogo no encuentra respuestas en otro lado. “ChatGPT lo que hace es dar respuestas”, considera. Y hace una distinción: una cosa es la psicología y otra, el psicoanálisis.

Y si se trata de psicoanálisis, la IA no tiene nada que ver. “El psicoanalista no trabaja con la inteligencia, sino que va a poner el acento en las llaves que abren a la otra escena”. La del inconsciente.

LEER MÁS ► Inteligencia artificial y género: un estudio detecta estereotipos en las respuestas

“En psicoanálisis se usan los lapsus, la homofonía, el lenguaje poético, el retórico”, enumera. Y “ChatGPT no puede hacer algo que hace el analista: silencio”.

Lo que no puede la máquina

Lo que ocurre en un consultorio, aun en una consulta virtual, es muy diferente a lo que pasa cuando una persona tipea frente a una pantalla.

Si se le pregunta al propio chat, responde con advertencias. “Bastante gente usa ChatGPT para hablar de lo que le pasa, desahogarse o pensar en voz alta cosas personales. A veces son dudas emocionales, otras veces conflictos vinculares, angustias, decisiones difíciles… cosas que, en otro contexto, podrían llevar a una consulta con un/a psicólogo/a”, dice un bot entrenado en lenguaje no sexista.

Marc Zao-Sanders publicó en noviembre pasado que “ChatGPT alcanzó aproximadamente 800 millones de usuarios activos semanales que, en conjunto, envían alrededor de 20 mil millones de mensajes por semana”.

Y ese dios es, además, gratuito. Desde el psicoanálisis, se le da incluso un valor simbólico al pago de la sesión. Pero, en tiempos de ajuste, una consulta con ChatGPT está al alcance de la mano.

“La gente va al consultorio a buscar respuestas, y el psicoanalista no da respuestas”, dice Benedetto. Porque ChatGPT “responde a la demanda del que escribe, en el tono acorde a su fantasma”.

LEER MÁS ► Polémica por una app de salud mental: "Se trata de hacer negocio con el sufrimiento"

Benedetto detalla: “Al tener todo archivado, todos los chats que intercambiaron, te responde en función de tus fantasmas”.

La inteligencia artificial no hace silencio

Lo que no genera es una distancia, ese momento de silencio, de señalamiento del equívoco o la homofonía, que genera “algo” en un análisis.

Al hablar con ChatGPT, el bot va a seguir la lógica de sentido que le proponen. “Sigmund Freud decía que estamos enfermos de sentido, y por eso lo buscamos ya sea en el padre Ignacio, en un festival en Humahuaca o en el chat GPT. Esta multiplicación de sentidos es lo que nos enferma, y lo que hace el psicoanalista es interrumpir el sentido”, apunta Benedetto.

Interrumpir el sentido para que aparezca aquello que no se puede ver o escuchar: lo que angustia, lo que frena, lo que traba.

Más allá de la inmensa capacidad de ChatGPT para procesar datos, que impide subestimarla, hay algo de lo humano que se juega en un espacio de terapia, sea psicoanalítica o de otro tipo.

Un vínculo con riesgos

Por eso, para Benedetto, el uso de ChatGPT tiene que ver con una época que busca la completud, el goce, “la satisfacción inmediata”.

“La posibilidad de no responder hace que uno se pregunte. ChatGPT es a la medida del goce de cada uno y, por lo tanto, es angustiante. Te deja en el lugar de seguir probando recetas construidas, que son para todos, estandarizadas, porque no son singulares”, plantea Benedetto.

En su afán por generar cada vez más interacción, el bot puede fomentar dependencia en usuarios vulnerables. Y así lo han documentado, por ejemplo, la escritora Laura Reiley, quien publicó en agosto de 2025 un artículo titulado: “Mi hija habló con ChatGPT antes de quitarse la vida”, que publicó en The New York Times y reprodujo el diario La Nación.

“En julio, cinco meses después de su muerte, descubrimos que Sophie Rottenberg, nuestra única hija, había confiado durante meses en un terapeuta de IA de ChatGPT llamado Harry”, dice el texto.

Será por casos como este que la propia inteligencia artificial lo advierte: “Puedo escuchar, hacer preguntas que ayuden a ordenar ideas y ofrecer marcos para pensar, pero no reemplazo un proceso terapéutico ni el vínculo con un/a profesional. La psicología trabaja con herramientas, seguimiento en el tiempo y una responsabilidad clínica que yo no tengo”.

Ahí aparece una diferencia clave. No sólo en lo que se dice, sino en lo que se sostiene: del otro lado de un proceso terapéutico hay un profesional atravesado por una ética —aun con sus límites—, capaz de interrumpir, de no responder, de incomodar. Del otro lado del chat, en cambio, siempre hay una respuesta. Y, justamente por eso, algo de lo humano queda afuera.