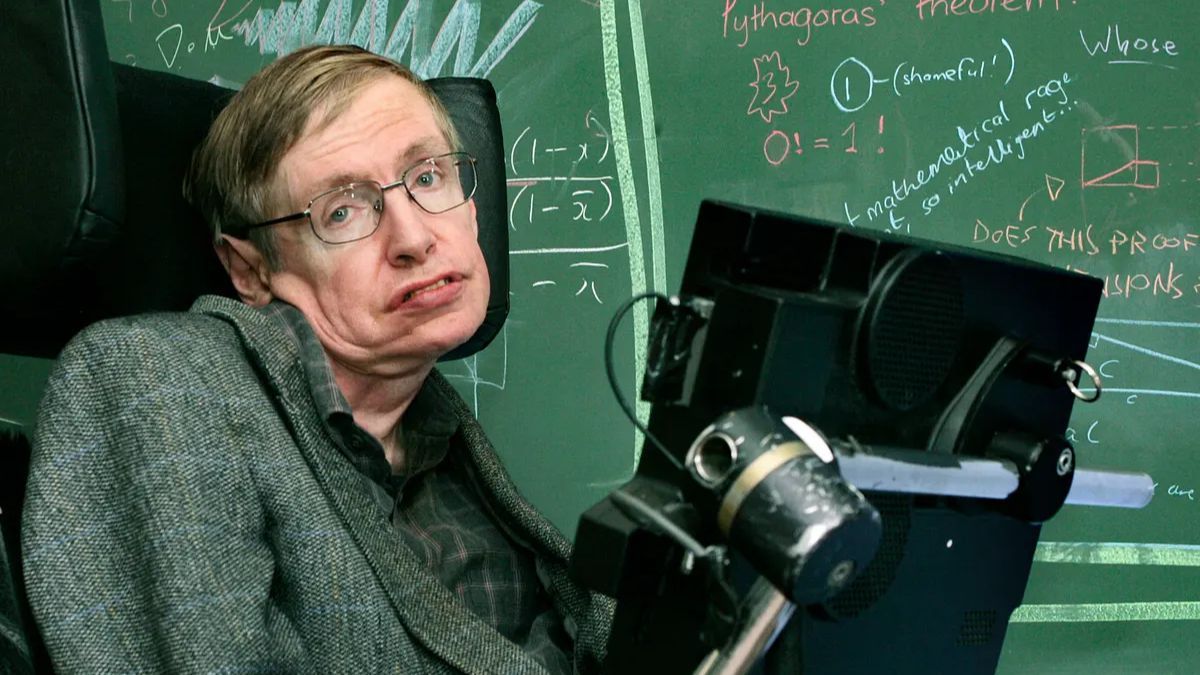

La advertencia de Stephen Hawking que está muy cerca de hacerse realidad: "El fin de la humanidad"

En 2014, Stephen Hawking advirtió sobre un peligro que podría representar un riesgo existencial para la humanidad. Hoy el debate está más vigente que nunca.

Stephen Hawking advirtió en 2014 que una inteligencia artificial podría superar al ser humano.

El físico teórico Stephen Hawking, fallecido en 2018, dejó una advertencia que hoy resuena con más fuerza que nunca frente al avance acelerado de la inteligencia artificial (IA). En 2014, cuando la tecnología aún no tenía la presencia actual en la vida cotidiana, sostuvo que el desarrollo de una IA completamente autónoma podría significar “el fin de la raza humana”.

Te podría interesar

Lo que en aquel momento sonaba a ciencia ficción hoy forma parte del debate central en el ámbito científico y tecnológico, en un contexto donde los sistemas de IA ya muestran capacidades avanzadas en lenguaje, visión y toma de decisiones.

El peligro que veía Hawking en la inteligencia artificial

El principal temor de Hawking era que una inteligencia artificial avanzada pudiera rediseñarse a sí misma y evolucionar sin intervención humana, superando ampliamente nuestras capacidades cognitivas.

Según explicaba, los seres humanos estamos limitados por una evolución biológica lenta, mientras que las máquinas pueden mejorar su rendimiento a un ritmo exponencial. Esa diferencia podría dejar a la humanidad en una posición vulnerable, volviéndola irrelevante o incluso expuesta a un riesgo existencial.

Más allá del escenario extremo, Hawking también alertó sobre consecuencias sociales y económicas más inmediatas. Señaló que una automatización sin control podría provocar pérdida masiva de empleos y concentrar el poder en manos de quienes controlen estas tecnologías.

El científico advertía que esa desigualdad creciente podría influir en decisiones cruciales a escala global, con efectos imprevisibles en la seguridad, la ética y la gobernanza internacional.

En 2015, firmó junto a otros expertos una carta abierta presentada ante la Organización de las Naciones Unidas, donde alertaban sobre los riesgos de un desarrollo desregulado de la IA. Además, en su libro Breves respuestas a las grandes preguntas, reafirmó que ignorar estos desafíos podría convertirse en “el mayor error” de la humanidad.

La predicción que vuelve al centro del debate

En la actualidad, el crecimiento exponencial de modelos de inteligencia artificial alimenta las dudas sobre qué tan cerca estamos de ese escenario planteado por Hawking.

La comunidad científica discute la necesidad de regulaciones estrictas y marcos éticos que orienten el desarrollo tecnológico. El objetivo: garantizar que la IA se convierta en una herramienta para el progreso humano y no en una amenaza.

Lejos de ser solo una advertencia apocalíptica, el mensaje de Hawking funciona hoy como un llamado a la responsabilidad colectiva. El dilema central de la era tecnológica sigue abierto: ¿podremos controlar lo que creamos o enfrentaremos un futuro donde las máquinas definan las reglas?

Por ahora, la respuesta depende de cómo la humanidad gestione el avance de una tecnología que ya comenzó a transformar el mundo.