El fundador de OpenAI planea un búnker para proteger a científicos ante el "caos" que podría desatar la nueva IA

Una figura clave de la inteligencia artificial plantea medidas extraordinarias ante un futuro incierto. El debate sobre la seguridad tecnológica suma tensión.

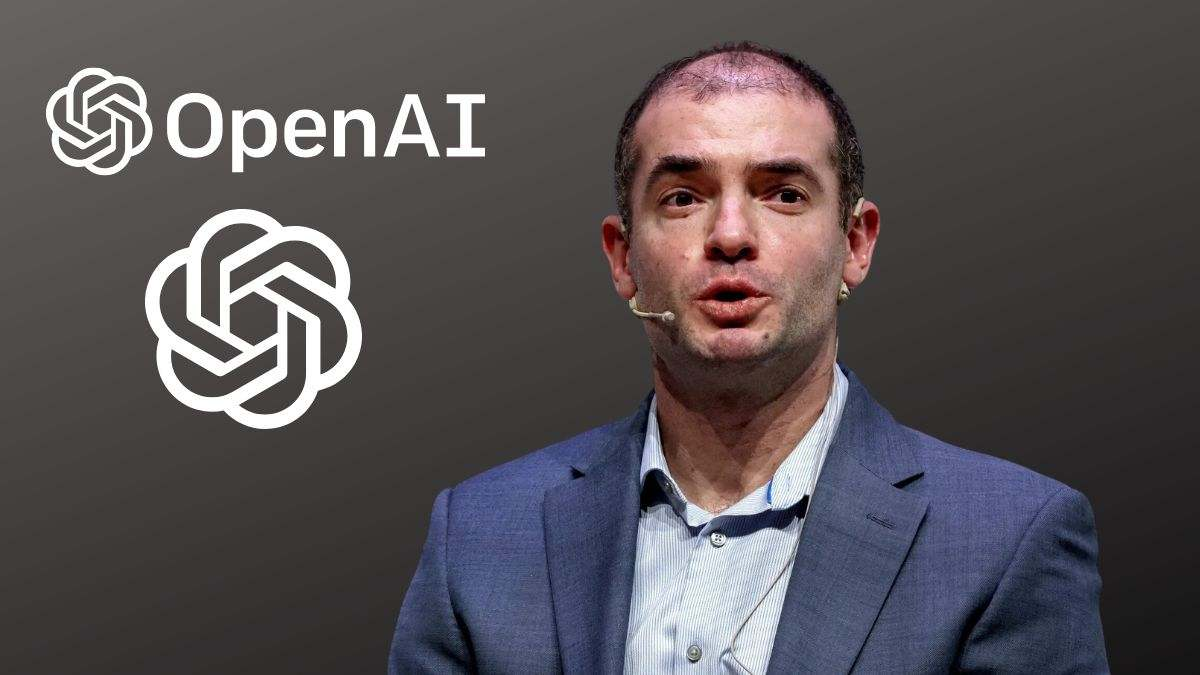

Ilya Sutskever, uno de los fundadores de OpenAI y mente clave detrás de ChatGPT, propuso la creación de un búnker de seguridad para proteger a los principales investigadores de la inteligencia artificial ante posibles riesgos derivados del lanzamiento de una Inteligencia Artificial General (AGI).

Te podría interesar

Inteligencia Artificial General: ¿Qué es? ¿Para qué sirve?

Ilya Sutskever plantea un refugio para proteger a científicos ante el impacto de la IA General

El especialista en aprendizaje automático y exmiembro de OpenAI, Ilya Sutskever, alertó sobre la necesidad de preparar un refugio seguro para los científicos que trabajan en proyectos de inteligencia artificial avanzada. Según Sutskever, cuando se desarrolle una AGI, capaz de superar las habilidades humanas, podría generarse un “éxtasis social” y conflictos geopolíticos que pondrían en riesgo la seguridad de los investigadores.

En una reunión en 2023, citada por The Atlantic, el cofundador de OpenAI afirmó que los científicos deberán ingresar a un búnker de protección antes del lanzamiento de la AGI. “Definitivamente vamos a construirlo”, aseguró, aunque aclaró que su uso será opcional .

¿Qué es la Inteligencia Artificial General y por qué genera preocupación?

La AGI es una forma avanzada de inteligencia artificial que puede realizar cualquier tarea cognitiva humana. Actualmente, es un concepto teórico, pero su desarrollo promete revolucionar múltiples sectores. Sin embargo, este avance podría provocar tensiones políticas y sociales a nivel global, tal como advierte Sutskever.

Este escenario ha impulsado a expertos como Sutskever a anticipar medidas de seguridad para resguardar la integridad física y mental de quienes lideran estos desarrollos tecnológicos .

Breve perfil de Ilya Sutskever, figura clave en la inteligencia artificial

- Nacido en 1986 en la antigua Unión Soviética, Sutskever se mudó a Israel en su infancia y luego a Canadá.

- Es reconocido por sus aportes en redes neuronales convolucionales junto a Geoffrey Hinton, considerado uno de los padres de la IA.

- En 2015, cofundó OpenAI junto a Sam Altman, Elon Musk y otros.

- Fue uno de los principales impulsores de ChatGPT y miembro influyente hasta su salida en 2024.

- Actualmente dirige Safe SuperIntelligence, una empresa enfocada en el desarrollo ético y seguro de la inteligencia artificial .

LEER MÁS►Las 5 cosas que nunca deberías compartir con ChatGPT

Implicancias y debates sobre la seguridad en el desarrollo de la IA

La propuesta de construir un búnker refleja la creciente preocupación en la comunidad tecnológica sobre los posibles efectos adversos del desarrollo acelerado de la IA. Este debate abarca riesgos éticos, sociales y geopolíticos.

Sutskever, descrito como un visionario dentro del sector, insiste en que las medidas de protección para los científicos serán fundamentales en el futuro cercano .