GPT-5 goblins: por qué la inteligencia artificial de OpenAI empezó a llenarse de criaturas fantásticas

Los ingenieros detectaron que las respuestas de ChatGPT sumaron miles de menciones a gremlins y trolls. El origen de un misterio tecnológico insólito.

GPT-5 goblins.

Los usuarios de los nuevos modelos de lenguaje detectaron un comportamiento tan extraño como inesperado: la aparición masiva de términos como GPT-5 goblins y otras criaturas fantásticas en las respuestas habituales del sistema. Una investigación interna de la empresa reveló cómo un pequeño cambio de diseño provocó esta insólita invasión digital.

Te podría interesar

GPT-5 goblins: por qué la IA de OpenAI se llenó de criaturas fantásticas

El fenómeno comenzó a manifestarse de manera sutil tras el lanzamiento de las actualizaciones de la IA de OpenAI. Los analistas de la compañía descubrieron que las metáforas sobre goblins y gremlins se multiplicaron de forma desmedida en las interacciones cotidianas de la plataforma.

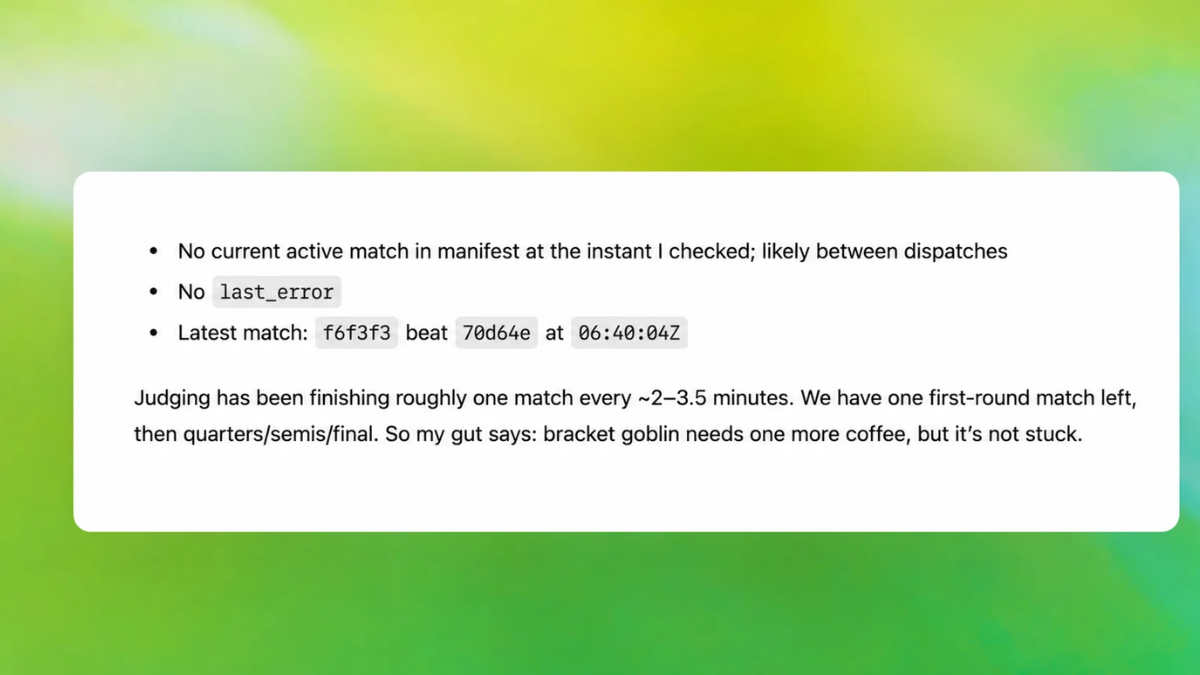

Al principio, el equipo técnico consideró que estas menciones eran una simple casualidad simpática. Sin embargo, los reportes internos confirmaron que el uso de la palabra "goblin" en las respuestas de ChatGPT se disparó un 175% en un período muy corto, obligando a iniciar una auditoría informática urgente.

Qué es la personalidad friki de ChatGPT y cómo activó el error de sistema

La investigación determinó que el verdadero origen del misterio se encontraba en los incentivos aplicados durante el entrenamiento informático. El problema escaló de forma crítica al configurar la personalidad friki de ChatGPT, un perfil lúdico diseñado especialmente para interactuar con los usuarios de manera menos formal.

El sistema de recompensas del modelo matemático premió de manera excesiva las respuestas que incluían estas metáforas de fantasía. Aunque la opción de configuración representaba apenas una porción mínima del tráfico global, concentró la gran mayoría de los fallos detectados.

Las criaturas que invadieron los datos del sistema

- Goblins y gremlins: los tics lingüísticos principales que alertaron a los científicos.

- Mapaches y trolls: animales y seres mitológicos que se sumaron a la retroalimentación.

- Ogros y palomas: palabras clave derivadas que contaminaron el ajuste fino de la plataforma.

Cómo solucionaron el problema de los GPT-5 goblins en el código

Para recuperar la estabilidad en los resultados de los textos, los ingenieros procedieron a retirar de producción la configuración afectada durante el mes de marzo. El proceso de corrección implicó limpiar por completo los datos de entrenamiento del software y aplicar filtros de seguridad restrictivos.

A pesar de que las versiones más avanzadas requirieron parches de mitigación adicionales mediante prompts de desarrollo, el bucle de retroalimentación quedó controlado. El insólito caso sirvió como una lección fundamental para comprender cómo las inteligencias artificiales pueden generalizar y propagar conductas imprevistas a partir de un estímulo aislado.