"La tecnología no inventó la violencia, pero la intensificó": el análisis de una especialista sobre los deepfakes

La comunicadora e investigadora en Género, Victoria Batiston, habló en AIRE para explicar cómo los deepfakes profundizan desigualdades históricas y por qué el marco legal aún no alcanza para proteger a las víctimas.

La comunicadora e investigadora en género Victoria Batiston habló en AIRE para explicar cómo los deepfakes profundizan desigualdades históricas y por qué el marco legal aún no alcanza para proteger a las víctimas.

La licenciada en Comunicación Social e investigadora en comunicación y género, Victoria Batiston, encabezó una charla en la Biblioteca Sarmiento de la ciudad de Santa Fe el pasado martes 25 de noviembre, en el marco del Día Internacional de la Eliminación de la Violencia contra la Mujer.

Te podría interesar

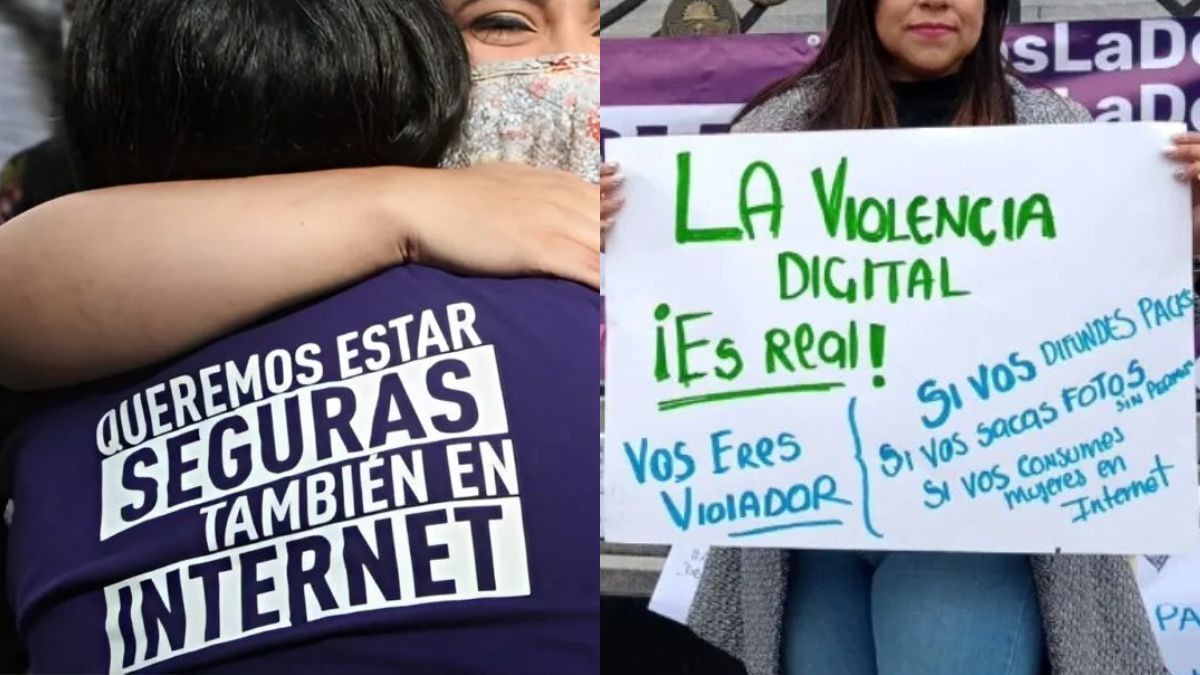

La actividad llevó el título “Violencia digital, deepfakes y género” y consolidó un debate urgente: cómo las nuevas tecnologías amplifican desigualdades que afectan, de manera desproporcionada, a mujeres, niñas y diversidades.

Los deepfakes son imágenes, videos o audios que son editados o generados utilizando herramientas de inteligencia artificial, y que pueden mostrar personas reales o inexistentes. En diálogo con el programa Santa Siesta, que se emite cada tarde en AIRE, Batiston explicó que la problemática no nace con la tecnología, pero sí se amplifica a escala masiva: “Si antes un acosador esperaba en la puerta de tu casa, hoy ese hostigamiento se multiplica por WhatsApp y redes sociales”.

La investigadora puso como ejemplo el caso de San Jerónimo Sud, que se transformó en un antecedente nacional. En esa localidad de 3.000 habitantes, un hombre falsificó imágenes de mujeres —incluso menores— y las distribuyó por canales de mensajería. “Más allá de que el contenido sea falso, el daño psicológico es real y se agrava en pueblos donde todos se conocen”, señaló.

Un marco legal que no alcanza para proteger a las víctimas

Batiston remarcó que la violencia digital avanza mucho más rápido que las regulaciones. “La Justicia sigue interpretando delitos tradicionales para resolver casos nuevos”, explicó. En la actualidad, los fallos sobre deepfakes suelen apoyarse en figuras ya tipificadas, como injurias o daños, mientras se espera una legislación más específica.

La investigadora recordó que en 2023 se sancionó la Ley Olimpia en Argentina, que incorporó la violencia digital como forma de violencia de género. La normativa permite dictar medidas cautelares para obligar a plataformas a retirar contenido dañino, pero no resuelve todas las situaciones que viven las víctimas.

A esto se suma un obstáculo mayor: la violencia institucional. “Cuando buscan justicia aparece un segundo nivel de violencia. El Estado todavía no está preparado para estas tecnologías”, advirtió.

Batiston celebró que en la reciente propuesta de reforma constitucional de Santa Fe aparecieran temas como derechos digitales, protección de datos y transparencia algorítmica, que podrían orientar políticas futuras.

Adolescentes, periodistas y figuras públicas: quiénes están más expuestas

Luego, Batiston apuntó a cómo afecta esta violencia a colectivos específicos. Mencionó casos de escuelas secundarias donde adolescentes falsificaron imágenes de compañeras, y también situaciones que involucran a periodistas y mujeres con alta presencia digital.

Citó ejemplos recientes como el hostigamiento y la creación de deepfakes contra la periodista Julia Mengolini: “Muchas mujeres que trabajan en medios digitales cuentan que reciben ataques, descalificaciones y violencia cada vez que opinan”.

LEER MÁS ► Crimen de la profesora de danzas y su madre en Rosario: los desgarradores audios del 911

Alfabetización digital y responsabilidad de los medios

Batiston planteó que una salida posible es fortalecer la formación digital, tanto para jóvenes como para adultosComentó aportes de la Defensoría del Público, que recomienda un enfoque responsable al comunicar sobre violencia digital: no revictimizar, proteger datos personales, evitar titulares sensacionalistas y promover editoras de género que supervisen el tratamiento informativo.

“Muchos medios se están replanteando cómo trabajan estos temas, pero todavía encontramos coberturas que empeoran la situación”, expresó.